Вештачка интелигенција

| Овај чланак је део серије о |

| вештачкој интелигенцији (AI) |

|---|

Вештачка интелигенција (енгл. artificial intelligence — AI) је подобласт рачунарства која развија и проучава интелигентне машине.[1][2] Вештачка интелигенција је интелигенција машина или софтвера, за разлику од интелигенције живих бића, првенствено људи. Циљ истраживања вештачке интелигенције је развијање програма (софтвера), који ће рачунарима омогућити да се понашају на начин који би се могао окарактерисати интелигентним. Прва истраживања се вежу за саме корене рачунарства. Идеја о стварању машина које ће бити способне да обављају различите задатке интелигентно, била је централна преокупација научника области рачунарства који су се определили за истраживање вештачке интелигенције, током целе друге половине 20. века. Савремена истраживања у вештачкој интелигенцији су оријентисана на експертске и преводилачке системе у ограниченим доменима, препознавање природног говора и писаног текста, аутоматске доказиваче теорема, као и константно интересовање за стварање генерално интелигентних аутономних агената. Вештачка интелигенција као појам у ширем смислу, означава капацитет једне вештачке творевине за реализовање функција које су карактеристика људског размишљања. Могућност развоја сличне творевине је будила интересовање људи још од античког доба; ипак, тек у другој половини 20. века таква могућност је добила прва оруђа (рачунаре), чиме се отворио пут за тај подухват.[3] Потпомогнута напретком модерне науке, истраживања на пољу вештачке интелигенције се развијају у два основна смера: психолошка и физиолошка истраживања природе људског ума, и технолошки развој све сложенијих рачунарских система. У том смислу, појам вештачке интелигенције се првобитно приписао системима и рачунарским програмима са способностима реализовања сложених задатака, односно симулацијама функционисања људског размишљања, иако и дан данас, прилично далеко од циља. У тој сфери, најважније области истраживања су обрада података, препознавање модела различитих области знања, игре и примијењене области, као на пример медицина. Технологија вештачке интелигенције се широко користи у индустрији, влади и науци. Неке апликације високог профила су: напредни веб претраживачи (нпр. Гугл претрага), системи препорука (које користе Јутјуб, Амазон и Нетфликс), интеракција путем људског говора (нпр. Гугл асистант, Сири и Алекса), самостална вожња аутомобила (нпр. Вејмо), генеративни и креативни алати (нпр. ChatGPT[4][5] и уметност вештачке интелигенције[6]), и надљудска игру и анализа у стратешким играма (нпр. шах и го).[7]

Неке области данашњих истраживања обрађивања података се концентришу на програме који настоје оспособити рачунар за разумевање писане и вербалне информације, стварање резимеа, давање одговара на одређена питања или редистрибуцију података корисницима заинтересованим за одређене делове тих информација. У тим програмима је од суштинског значаја капацитет система за конструисање граматички коректних реченица и успостављање везе између речи и идеја, односно идентификовање значења. Истраживања су показала да, док је проблеме структурне логике језика, односно његове синтаксе, могуће решити програмирањем одговарајућих алгоритама, проблем значења, или семантика, је много дубљи и иде у правцу аутентичне вештачке интелигенције. Основне тенденције данас, за развој система вештачке интелигенције представљају: развој експертских система и развој неуронских мрежа. Експертски системи покушавају репродуковати људско размишљање преко симбола. Неуронске мреже то раде више из биолошке перспективе (рекреирају структуру људског мозга уз помоћ генетских алгоритама). Упркос сложености оба система, резултати су веома далеко од стварног интелигентног размишљања. Многи научници су скептици према могућности развијања истинске вештачке интелигенције. Функционисање људског размишљања, још увек није дубље познато, из ког разлога ће информатички дизајн интелигентних система, још дужи временски период бити у суштини онеспособљен за представљање тих непознатих и сложених процеса. Истраживања вештачке интелигенције су фокусирана на следеће компоненте интелигенције: учење, размишљање, решавање проблема, перцепција и разумијевање природног језика.

Алан Тјуринг је био прва особа која је спровела значајна истраживања у области коју је назвао машинска интелигенција.[8] Вештачка интелигенција је основана као академска дисциплина 1956. године.[9] Поље је прошло кроз више циклуса оптимизма,[10][11] праћених периодима разочарења и губитка финансирања, познатим као зима вештачке интелигенције.[12][13] Финансирање и интересовање су се знатно повећали након 2012. када је дубоко учење надмашило све претходне технике вештачке интелигенције,[14] и после 2017. са архитектуром трансформатора.[15] Ово је довело до пролећа вештачке интелигенције почетком 2020-их, при чему су компаније, универзитети и лабораторије које су претежно са седиштем у Сједињеним Државама, остварили значајне пионирске напретке у вештачкој интелигенцији.[16] Све већа употреба вештачке интелигенције у 21. веку утиче на друштвени и економски помак ка повећању аутоматизације, доношења одлука заснованих на подацима и интеграцији система вештачке интелигенције у различите економске секторе и области живота, утичући на тржишта рада, здравство, владу , индустрија и образовање. Ово поставља питања о етичким импликацијама и ризицима од вештачке интелигенције, што подстиче дискусије о регулаторним политикама како би се осигурала безбедност и предности технологије. Различите подобласти вештачке интелигенције су истраживања усредсређена на одређене циљеве и употребу специфичних алата. Традиционални циљеви истраживања вештачке интелигенције обухватају расуђивање, представљање знања, планирање, учење, обрада природног језика, перцепција и подршка роботици.[а] Општа интелигенција (способност да се обави било који задатак који човек може да изврши) спада у дугорочне циљеве у овој области.[17] Да би решили ове проблеме, истраживачи вештачке интелигенције су прилагодили и интегрисали широк спектар техника решавања проблема, укључујући претрагу и математичку оптимизацију, формалну логику, вештачке неуронске мреже и методе засноване на статистици, операционом истраживању и економији.[б] Вештачка интелигенција се такође ослања на психологију, лингвистику, филозофију, неуронауку и друге области.[18]

Циљеви

[уреди | уреди извор]Општи проблем симулације (или стварања) интелигенције подељен је на подпроблеме. Они се састоје од одређених особина или способности које истраживачи очекују да интелигентни систем покаже. Испод описане особине су задобиле највише пажње и покривају обим истраживања вештачке интелигенције.[а]

Основни циљеви истраживања на пољу вештачке интелигенције

[уреди | уреди извор]Тренутно, када су у питању истраживања на пољу вештачке интелигенције, могуће је постићи два комплементарна циља, који респективно наглашавају два аспекта вештачке интелигенције, а то су теоријски и технолошки аспект.

Први циљ је студија људских когнитивних процеса уопште, што потврђује дефиницију Патрика Ј. Хејеса - „студија интелигенције као компутације“, чиме се вештачка интелигенција усмерава ка једној својеврсној студији интелигентног понашања код људи.

Вештачка интелигенција, као област информатике, бави се пројектовањем програмских решења за проблеме које настоји решити.

Размишљање и решавање проблема

[уреди | уреди извор]Размишљање је процес извлачења закључака који одговарају датој ситуацији. Закључци се класификују као дедуктивни и индуктивни. Пример дедуктивног начина закључивања би могао бити, „Саво је или у музеју, или у кафићу. Није у кафићу; онда је сигурно у музеју“; и индуктивног, „Претходне несреће ове врсте су биле последица грешке у систему; стога је и ова несрећа узрокована грешком у систему“. Најзначајнија разлика између ова два начина закључивања је да, у случају дедуктивног размишљања, истинитост премисе гарантује истинитост закључка, док у случају индуктивног размишљања истинитост премисе даје подршку закључку без давања апсолутне сигурности његовој истинитости. Индуктивно закључивање је уобичајено у наукама у којима се сакупљају подаци и развијају провизиони модели за опис и предвиђање будућег понашања, све док се не појаве аномалије у моделу, који се тада реконструише. Дедуктивно размишљање је уобичајено у математици и логици, где детаљно обрађене структуре непобитних теорема настају од мањих скупова основних аксиома и правила. Постоје значајни успеси у програмирању рачунара за извлачење закључака, нарочито дедуктивне природе. Ипак, истинско размишљање се састоји од сложенијих аспеката; укључује закључивање на начин којим ће се решити одређени задатак, или ситуација. Ту се налази један од највећих проблема с којим се сусреће вештачка интелигенција.

Решавање проблема, нарочито у вештачкој интелигенцији, карактерише систематска претрага у рангу могућих акција с циљем изналажења неког раније дефинисаног решења. Методе решавања проблема се деле на оне посебне и оне опште намене. Метода посебне намене је тражење адаптираног решења за одређени проблем и садржи врло специфичне особине ситуација од којих се проблем састоји. Супротно томе, метод опште намене се може применити на шири спектар проблема. Техника опште намене која се користи у вештачкој интелигенцији је метод крајње анализе, део по део, или постепено додавање, односно редуковање различитости између тренутног стања и крајњег циља. Програм бира акције из листе метода - у случају једноставног робота кораци су следећи: PICKUP, PUTDOWN, MOVEFROWARD, MOVEBACK, MOVELEFT и MOVERIGHT, све док се циљ не постигне. Већи број различитих проблема су решени преко програма вештачке интелигенције. Неки од примера су тражење победничког потеза, или секвенце потеза у играма, сложени математички докази и манипулација виртуелних објеката у вештачким, односно синтетичким рачунарским световима.

Рани истраживачи су развили алгоритме који су имитирали размишљање корак по корак које људи користе када решавају загонетке или извођењу логичког закључка.[19] До касних 1980-их и 1990-их, развијене су методе за рад са несигурним или непотпуним информацијама, користећи концепте вероватноће и економије.[20]

Многи од ових алгоритама су недовољни за решавање великих проблема резоновања, јер доживљавају „комбинаторијску експлозију“: они постају експоненцијално спорији како проблеми постају све већи..[21] Чак и људи ретко користе дедукцију корак по корак, коју би рано истраживање вештачке интелигенције могло да моделира. Они решавају већину својих проблема користећи брзе, интуитивне одлуке.[22] Тачно и ефикасно резоновање је нерешен проблем.

Репрезентација знања

[уреди | уреди извор]

Представљање знања и инжењеринг знања[23] омогућавају програмима вештачке интелигенције да интелигентно одговарају на питања и доносе закључке о чињеницама из стварног света. Формалне репрезентације знања се користе у индексирању и претрагама заснованим на садржају,[24] тумачењу сцене,[25] подршци при доношењу клиничких одлука,[26] откривању знања (деривација „занимљивих“ и практичних закључака из великих база података)[27] и другим областима.[28]

База знања је тело знања представљено у облику који може да користи програм. Онтологија је скуп објеката, односа, концепата и својстава које користи одређени домен знања.[29] Базе знања треба да представљају ствари као што су: објекти, својства, категорије и односи између објеката;[30] ситуације, догађаји, стања и време;[31] узроци и последице;[32] знање о знању (шта знамо о томе што други људи знају);[33] подразумевано резоновање (ствари за које људи претпостављају да су истините док им се не каже другачије, и остаће истините чак и када се друге чињенице мењају);[34] и многи други аспекти и домени знања.

Међу најтежим проблемима у представљању знања су: ширина здраворазумског знања (скуп атомских чињеница које просечна особа зна је огроман);[35] и подсимболички облик већине здраворазумског знања (већи део онога што људи знају није представљен као „чињенице“ или „изјаве“ које би могли вербално да изразе).[22] Постоји такође тешкоћа стицања знања, проблем добијања знања за ВИ апликације.[в]

Планирање и доношење одлука

[уреди | уреди извор]„Агент“ је све што опажа и предузима акције у свету. Рационални агент има циљеве или преференције и предузима акције да их оствари.[г][38] У аутоматизованом планирању, агент има специфичан циљ.[39] У аутоматизованом доношењу одлука, агент има преференције – постоје неке ситуације у којима би преферирао да буде, а неке покушава да избегне. Агент за доношење одлука свакој ситуацији додељује број (који се назива „корисност”) који мери колико је агент преферира. За сваку могућу акцију, може се израчунати „очекивана корисност“: корисност свих могућих исхода акције, пондерисана вероватноћом да ће се исход догодити. Затим се може изабрати акција са максималном очекиваном корисношћу.[40]

У класичном планирању, агент тачно зна какав ће бити ефекат било које акције.[41] У већини проблема у стварном свету, међутим, агент можда није сигуран у ситуацију у којој се налази (она је „непозната“ или „неуочљива“) и можда неће са сигурношћу знати шта ће се десити након сваке могуће акције (то није „детерминистичко”). Он мора да изабере акцију тако што ће направити пробабилистичку претпоставку, и затим поново проценити ситуацију да види да ли је акција била успешна.[42]

У неким проблемима, преференције агента могу бити неизвесне, посебно ако су укључени други агенти или људи. Оне се могу научити (нпр. уз инверзно учење са поткрепљивањем) или агент може тражити информације да побољша своје преференције.[43] Теорија вредности информација може се користити за одмеравање вредности истраживачких или експерименталних радњи.[44] Простор могућих будућих радњи и ситуација је обично нерешиво велик, тако да агенти морају да предузимају акције и процењују ситуације мада нису сигурни какав ће бити исход.

Марковљев процес одлучивања има транзициони модел који описује вероватноћу да ће одређена акција променити стање на одређени начин и функцију награђивања која обезбеђује корисност сваког стања и цену сваке акције. Устројство повезује одлуку са сваким могућим стањем. Курс одлука може да буде прорачунат (нпр. итерацијом), може бити хеуристичке природе или се може научити.[45]

Теорија игара описује рационално понашање више агената у интеракцији и користи се у ВИ програмима који доносе одлуке које укључују друге агенте.[46]

Учење

[уреди | уреди извор]Постоји више различитих облика учења који су примењени на област вештачке интелигенције. Најједноставнији се односи на учење на грешкама преко покушаја. На пример, најједноставнији рачунарски програм за решавање проблема матирања у једном потезу у шаху, је истраживање мат позиције случајним потезима. Једном изнађено решење, програм може запамтити позицију и искористити је следећи пут када се нађе у идентичној ситуацији. Једноставно памћење индивидуалних потеза и процедура - познато као механичко учење - је врло лако имплементирати у рачунарски систем. Приликом покушаја имплементације тзв. уопштавања, јављају се већи проблеми и захтеви. Уопштавање се састоји од примене прошлих искустава на аналогне нове ситуације. На пример, програм који учи прошла времена глагола на српском језику механичким учењем, неће бити способан да изведе прошло време, рецимо глагола скочити, док се не нађе пред обликом глагола скочио, где ће програм који је способан за уопштавање научити „додај -о и уклони -ти“ правило, те тако формирати прошло време глагола скочити, заснивајући се на искуству са сличним глаголима.

Машинско учење је проучавање програма који могу аутоматски побољшати своје перформансе на датом задатку.[47] Оно је било део вештачке интелигенције од почетка.[д]

Постоји неколико врста машинског учења. Учење без надзора анализира ток података, проналази обрасце и изводи предвиђања без икаквог спољашњег упутства.[50] Учење под надзором захтева од човека да прво означи улазне податке, и долази у две главне варијанте: класификација (где програм мора да научи да предвиди којој категорији улаз припада) и регресија (где програм мора да изведе нумеричку функцију на основу нумеричког уноса).[51]

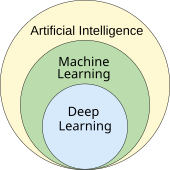

У подржаном учењу агент је награђен за добре одговоре и кажњен за лоше. Агент учи да бира одговоре који су класификовани као „добри“.[52] Трансферно учење примењује знање стечено из једног проблема на нови проблем.[53] Дубоко учење је врста машинског учења која покреће инпуте кроз биолошки инспирисане вештачке неуронске мреже за све ове врсте учења.[54]

Теорија рачунарског учења може проценити ученике према рачунској сложености, комплексности узорка (колико података је потребно) или другим појмовима оптимизације.[55]

Обрада природног језика

[уреди | уреди извор]Обрада природног језика (NLP)[56] омогућава програмима да читају, пишу и комуницирају на људским језицима као што је енглески. Специфични проблеми укључују препознавање говора, синтезу говора, машинско превођење, екстракцију информација, проналажење информација и одговарање на питања.[57]

Рани радови, засновани на генеративној граматици и семантичким мрежама Ноама Чомског, имали су потешкоћа са разазначавањем смисла речи[ђ] осим ако нису били ограничени на мале домене зване „микро-светови“ (због проблема са поимањем здравог разума[35]). Маргарет Мастерман је веровала да је значење, а не граматика, кључ за разумевање језика и да би тезауруси, а не речници, требало да буду основа рачунске језичке структуре.

Савремене технике дубоког учења за NLP укључују уграђивање речи (који представљају речи, типично као векторе који кодирају њихово значење),[58] трансформаторе (архитектура дубоког учења која користи механизам пажње)[59] и друге.[60] Године 2019, генеративни унапред обучени трансформаторски (или „GPT“) језички модели почели су да генеришу кохерентан текст,[61][62] и до 2023. ови модели су могли да остваре резултате на нивоу човека на правосудном испиту, SAT тесту, GRE тесту, и у многим другим апликацијама у стварном свету.[63]

Перцепција

[уреди | уреди извор]Машинска перцепција је способност да се користи улаз са сензора (као што су камере, микрофони, бежични сигнали, активни лидар, сонар, радар и тактилни сензори) да би се извели закључили о аспектима света. Компјутерски вид је способност анализе визуелног уноса.[64]

Ова област обухвата препознавање говора,[65] класификацију слика,[66] препознавање лица, препознавање објеката[67] и роботску перцепцију.[68]

Социјална интелигенција

[уреди | уреди извор]

Афективно рачунарство је интердисциплинарна област који се састоји од система који препознају, тумаче, обрађују или симулирају људска осећања, емоције и расположење.[70] На пример, неки виртуелни асистенти су програмирани да конверзационо разговарају или чак да се шале на духовит начин. Они су стога осетљивији на емоционалну динамику људске интеракције, или да на други начин олакшају интеракцију између човека и рачунара.

Међутим, ово има тенденцију да наивним корисницима пружи нереалну концепцију интелигенције постојећих компјутерских агената.[71] Умерени успеси у вези са афективним рачунарством укључују текстуалну анализу осећања и, у скорије време, мултимодалну анализу осећања, где ВИ класификује афекте које приказује субјект приказан на видео снимку.[72]

Општа интелигенција

[уреди | уреди извор]Машина са вештачком општом интелигенцијом требало би да буде у стању да реши широк спектар проблема са ширином и свестраношћу која је слична људској интелигенцији.[17]

Проблем дефиниције вештачке интелигенције

[уреди | уреди извор]За разлику од других области, у вештачкој интелигенцији не постоји сагласност око једне дефиниције, него их има више зависно од различитих погледа и метода за решавање проблема.

Дефиниција и циљеви

[уреди | уреди извор]Упркос времену које је прошло од када је Џон Макарти дао име овој области на конференцији одржаној 1956. године у Дартмуду, није нимало лако тачно дефинисати садржај и достигнућа вештачке интелигенције.

Највероватније, једна од најкраћих и најједноставнијих карактеристика која се приписује вештачкој интелигенцији, парафразирајући Марвина Минског, (једног од стручњака и најпознатијих истраживача вештачке интелигенције), је „конструисање рачунарских система са особинама које би код људских бића биле окарактерисане као интелигентне“.

Тјурингов тест

[уреди | уреди извор]

У познатом такозваном Тјуринговом тесту, који је Алан Тјуринг описао и објавио у једном чланку из 1950. године, под насловом Computing machinery and intelligence (Рачунске машине и интелигенција), предлаже се један експеримент чији је циљ откривање интелигентног понашања једне машине. Тест полази од једне игре у којој испитивач треба да погоди пол два интерлокутора, A и Б, а који се налазе у посебним и одвојеним собама. Иако обоје тврде да су женског пола, у ствари ради се о мушкарцу и жени. У изворном Тјуринговом предлогу урађена је извесна модификација, те је жену заменио рачунар. Испитивач треба да погоди ко је од њих машина, полазећи од њиховог међусобног разговора и имајући у виду да обоје тврде да су људи. Задатак треба постићи упркос чињеници да ниједан од интерлокутора није обавезан да говори истину, те на пример, машина може одлучити да да погрешан резултат једне аритметичке операције, или чак да га саопшти много касније како би варка била уверљивија.

По оптимистичкој хипотези самог Тјуринга, око 2000. године, већ је требало да постоје рачунари оспособљени за игру ове игре довољно добро, тако да просечан испитивач нема више од 70% шансе да уради исправну идентификацију, након пет минута постављања питања. Када би то данас заиста било тако, налазили би се пред једном истински интелигентном машином, или у најмању руку машином која уме да се представи као интелигентна. Не треба ни поменути да су Тјурингова предвиђања била превише оптимистична, што је био врло чест случај у самим почецима развоја области вештачке интелигенције. У стварности проблем није само везан за способност рачунара за обраду података, него на првом мјесту, за могућност програмирања рачунара са способностима за интелигентно понашање.

Вештачка интелигенција у образовању

[уреди | уреди извор]Сан о рачунарима који би могли да образују ученике и студенте, више деценија је инспирисао научнике когнитивне науке. Прва генерација таквих система (названи Computer Aided Instruction или Computer Based Instruction), углавном су се заснивали на хипертексту. Структура тих система се састојала од презентације материјала и питања са више избора, која шаљу ученика на даље информације, у зависности од одговора на постављена питања.

Наредна генерација ових система Intelligent CAI или Intelligent Tutoring Systems, заснивали су се на имплементацији знања о одређеној теми, у сам рачунар. Постајала су два типа оваквих система. Први је тренирао ученика у самом процесу решавања сложених проблема, као што је нпр. препознавање грешака дизајна у једном електричном колу или писање рачунарског програма. Други тип система је покушавао да одржава силогистички дијалог са студентима. Имплементацију другог типа система је било врло тешко спровести у праксу, великим делом због проблема програмирања система за разумевање спонтаног и природног људског језика. Из тог разлога, пројектовано их је само неколико.

Типични систем за тренирање ученика и студената се обично састоји од четири основне компоненте.

- Прва компонента је окружење у којем ученик или студент ради на решавању сложених задатака. То може бити симулација компоненте или компонената електронских уређаја представљена као серија проблема које студент треба да реши.

- Друга компонента је експертски систем који може решити представљене проблеме на којима студент ради.

- Трећу чини један посебан модул који може упоредити решења која нуди студент са онима које су уграђене у експертски систем и његов циљ је да препозна студентов план за решење проблема, као и које делове знања највероватније студент користи.

- Четврту чини педагошки модул који сугерише задатке које треба решити, одговара на питања студента и указује му на могуће грешке. Одговори на питања студента и сугестије за планирање решавања задатака, заснивају се на прикупљеним подацима из претходног модула.

Свака од ових компонената може користити технологију вештачке интелигенције. Окружење може садржати софистицирану симулацију или интелигентног агента, односно симулираног студента или чак опонента студенту. Модул који чини експертски систем се састоји од класичних проблема вештачке интелигенције, као што су препознавање плана и резоновање над проблемима који укључују неизвесност. Задатак педагошког модула је надгледање плана инструкције и његово адаптирање на основу нових информација о компетентности студента за решавање проблема. Упркос сложености система за тренирање ученика и студената, пројектовани су у великом броју, а неки од њих се регуларно користе у школама, индустрији и за војне инструкције.

Технике

[уреди | уреди извор]Истраживање вештачке интелигенције користи широк спектар техника за постизање горе наведених циљева.[б]

Претрага и оптимизација

[уреди | уреди извор]ВИ може да реши многе проблеме интелигентним претраживањем многих могућих решења.[73] Постоје две веома различите врсте претраге које се користе у ВИ: претрага простора стања и локална претрага.

Претрага простора стања

[уреди | уреди извор]Претрага простора стања претражује стабло могућих стања како би покушала да пронађе циљно стање.[74] На пример, алгоритми планирања претражују кроз стабла циљева и подциљева, покушавајући да пронађу пут до жељеног циља, процес који се назива анализа средстава и циљева.[75]

Једноставне исцрпне претраге[76] ретко су довољне за већину проблема из стварног света: простор за претрагу (број места за претрагу) брзо расте до астрономских размера. Резултат је претрага која је преспора или се никада не завршава.[21] „Хеуристика“ или „правила палца“ могу помоћи да се одреде приоритети избора за које је већа вероватноћа да ће постићи циљ.[77]

Супарничка претрага се користи за програме за играње игара, као што су шах или го. Она претражује стабло могућих потеза и контра-потеза, тражећи победничку позицију.[78]

Локална претрага

[уреди | уреди извор]

Локална претрага користи математичку оптимизацију да пронађе решење за проблем. Почиње неким обликом нагађања и постепено га рафинира.[79]

Опадајуће спуштање је врста локалне претраге која оптимизује скуп нумеричких параметара тако што их поступно прилагођава да би се минимизовала функција губитка. Варијанте градијентног спуштања се обично користе за обуку неуронских мрежа.[80]

Други тип локалне претраге је еволуционо рачунање, које има за циљ да итеративно побољша скуп решења кандидата тако што ће их „мутирати“ и „рекомбиновати“, бирајући само најспособније да преживе сваку генерацију.[81]

Дистрибуирани процеси претраживања могу да се координирају преко алгоритама ројевске интелигенције. Два популарна ројевска алгоритма који се користе у претраживању су оптимизација роја честица (инспирисана јатом птица) и оптимизација колонија мрава (инспирисана мрављим стазама).[82]

Логика

[уреди | уреди извор]Формална логика се користи за расуђивање и представљање знања.[83] Формална логика долази у два главна облика: пропозициона логика (која оперише на изјавама које су истините или нетачне, и користи логичке повезнице као што су „и“, „или“, „не“ и „имплицира“[84] и предикатска логика (која такође ради на објектима, предикатима и односима и користи квантификаторе као што су „Свако X је Y“ и „Постоје неки X-еви који су Y“).[85]

Логички закључак (или дедукција) је процес доказивања новог исказа (закључка) на основу других исказа за које се већ зна да су тачни (премисе).[86] Логичка база знања такође обрађује упите и тврдње као посебан случај закључивања.[87] Правило закључивања описује шта је ваљан корак у доказу. Најопштије правило закључивања је резолуција.[88] Закључивање се може свести на извођење претраге како би се пронашао пут који води од премиса до закључака, где је сваки корак примена правила закључивања.[89] Закључак изведен на овај начин је недосежан осим за кратке доказе у ограниченим доменима. Није откривен ниједан ефикасан, моћан и општи метод.

Расплинута логика приписује „степен истине“ између 0 и 1. Стога може да обрађује пропозиције које су нејасне и делимично тачне.[90] Немонотонске логике су дизајниране да обрађују подразумевано резоновање.[34] Друге специјализоване верзије логике су развијене да опишу многе сложене домене (погледајте репрезентацију знања изнад).

Пробабилистичке методе за неизвесно резоновање

[уреди | уреди извор]

Многи проблеми у области вештачке интелигенције (укључујући расуђивање, планирање, учење, перцепцију и роботику) захтевају од агента да ради са непотпуним или несигурним информацијама. Истраживачи вештачке интелигенције су осмислили бројне алате за решавање ових проблема користећи методе из теорије вероватноће и економије.[91]

Бајесове мреже[92] су веома општи алат који се може користити за многе проблеме, укључујући расуђивање (користећи алгоритам Бајесовог закључивања),[е][94] учење (користећи алгоритам максимизације очекивања),[ж][96] планирање (користећи мреже одлучивања)[97] и перцепцију (користећи динамичке Бајесове мреже).[98]

Пробабилистички алгоритми се такође могу користити за филтрирање, предвиђање, уједначавање и проналажење објашњења за токове података, помажући системима перцепције да анализирају процесе који се дешавају током времена (нпр. скривени Марковљеви модели или Калманови филтри).[98]

Развијени су прецизни математички алати који анализирају како агент може да доноси изборе и планира, користећи теорију одлучивања, анализу одлука,[99] и теорију вредности информација.[100] Ови алати укључују моделе као што су Марковљеви процеси одлучивања,[101] динамичке мреже одлучивања,[98] теорија игара и дизајн механизама.[102]

Класификатори и статистичке методе учења

[уреди | уреди извор]Најједноставније ВИ апликације се могу поделити у два типа: класификатори (нпр. „ако је сјајан онда је дијамант“), с једне стране, и контролери (нпр. „ако је дијамант онда га узми“), с друге стране. Класификатори[103] су функције које користе подударање шаблона за одређивање најближег подударања. Могу се фино подесити на основу одабраних примера коришћењем учења под надзором. Сваки образац (који се назива и „опсервација”) је означен одређеном унапред дефинисаном класом. Сва запажања у комбинацији са њиховим ознакама класа позната су као скуп података. Када се прими ново запажање, то запажање се класификује на основу претходног искуства.[51]

У употреби је много врста класификатора. Стабло одлучивања је најједноставнији и најчешће коришћени симболички алгоритам машинског учења.[104] Алгоритам К-најближег суседа је био најраспрострањенији аналогни вид вештачке интелигенције до средине 1990-их, а методе кернела као што је метода потпорних вектора (SVM) су замениле приступ к-најближег суседа током 1990-их.[105] Наивни Бајесов класификатор се сматра „највише коришћеним видом учења“[106] у Гуглу, делимично због своје скалабилности.[107] Неуронске мреже се такође користе као класификатори.[108]

Вештачке неуронске мреже

[уреди | уреди извор]

Вештачка неуронска мрежа се заснива на колекцији чворова познатих и као вештачки неурони, који лабаво моделују неуроне у биолошком мозгу. Она је обучена да препозна обрасце; када се једном обучи, може препознати те обрасце у свежим подацима. Постоји улаз, најмање један скривени слој чворова и излаз. Сваки чвор примењује функцију и када тежина пређе одређени праг, подаци се преносе на следећи слој. Мрежа се обично назива дубоком неуронском мрежом ако има најмање 2 скривена слоја.[108]

Алгоритми за учење за неуронске мреже користе локалну претрагу да би одабрали параметре које ће произвести адекватан излаз за сваки улаз током тренинга. Најчешћа техника обуке је алгоритам бекпропагације.[109] Неуронске мреже уче да моделују сложене односе између улаза и излаза и проналазе обрасце у подацима. У теорији, неуронска мрежа може научити било коју функцију.[110]

У неуронским мрежама директне комуникације сигнал пролази само у једном правцу.[111] Рекурентне неуронске мреже враћају излазни сигнал назад у улаз, што омогућава краткорочно памћење претходних улазних догађаја. Дуга краткорочна меморија је најуспешнија мрежна архитектура за рекурентне мреже.[112] Перцептрони[113] користе само један слој неурона, дубоко учење[114] користи више слојева. Конволуционе неуронске мреже јачају везу између неурона који су „блиски“ један другом – ово је посебно важно у обради слике, где локални скуп неурона мора да идентификује „ивицу“ пре него што мрежа може да идентификује објекат.[115]

Дубоко учење

[уреди | уреди извор]

Дубоко учење[114] користи неколико слојева неурона између улаза и излаза мреже. Више слојева може прогресивно извући карактеристике вишег нивоа из сировог уноса. На пример, у обради слике, нижи слојеви могу да идентификују ивице, док виши слојеви могу да идентификују концепте релевантне за човека као што су цифре, слова или лица.[116]

Дубоко учење је знатно побољшало перформансе програма у многим важним подобластима вештачке интелигенције, укључујући компјутерски вид, препознавање говора, обраду природног језика, класификацију слика[117] и друге. Разлог због којег дубоко учење има тако добре резултате у толиком броју апликација није познат према подацима из 2023. године.[118] До изненадног успеха дубоког учења 2012–2015. није дошло због неког новог открића или теоријског продора (дубоке неуронске мреже и пропагацију уназад су описали многи људи још од 1950-их)[з] већ због два фактора: невероватно повећање снаге рачунара (укључујући стоструко повећање брзине преласком на GPU процесоре) и доступност огромних количина података за обуку, посебно гигантских разврстаних скупова података који се користе за контролно тестирање, као што је ImageNet.[и]

GPT

[уреди | уреди извор]Генеративни унапред обучени трансформатори (GPT) су велики језички модели који се заснивају на семантичким односима између речи у реченицама (обрада природног језика). GPT модели засновани на тексту су унапред обучени за велики корпус текста који може бити преузет са интернета. Претходна обука се састоји у предвиђању следеће лексеме (токен је обично реч, подреч или интерпункција). Током ове пред-обуке, GPT модели акумулирају знање о свету, а затим могу да генеришу текст сличан оном који су људи створили понављањем предвиђања следећег токена. Типично, наредна фаза обуке чини модел истинитијим, кориснијим и безопаснијим, обично уз технику која се зове подржано учење на основу људских повратних информација (RLHF). Садашњи GPT модели су још увек склони генерисању неистина које се називају „халуцинације“, иако се то може смањити помоћу RLHF и података о квалитету. Користе се у чатботовима, који омогућавају кориснику да постави питање или да постави задатак једноставним текстом.[127][128]

Тренутни модели и услуге укључују: Гемини (раније Бард), ChatGPT, Грок, Клод, Копилот и LLaMA.[129] Мултимодални GPT модели могу да обрађују различите типове података (модалитета) као што су слике, видео записи, звук и текст.[130]

Специјализовани хардвер и софтвер

[уреди | уреди извор]Крајем 2010-их, графичке процесорске јединице (GPU) које су све више дизајниране са побољшањима специфичним за ВИ и коришћене са специјализованим TensorFlow софтвером, у знатној мери су замениле претходно коришћену централну процесорску јединицу (CPU) као доминантно средство за велике (комерцијалне и академске) обуке модела машинског учења.[131] Историјски гледано, коришћени су специјализовани језици, као што су Лисп, Пролог, Питон и други.

Примене

[уреди | уреди извор]Технологија вештачке интелигенције и машинског учења се користи у већини есенцијалних апликација 2020-их, укључујући: претраживаче (као што је Гугл претрага), циљање онлајн реклама, системе препорука (које нуде Нетфликс, Јутјуб или Амазон), повећање интернет саобраћаја, циљано оглашавање (Адсенс, Фејсбук), виртуелни асистенти (као што су Сири или Алекса), аутономна возила (укључујући дронове, ADAS и самовозеће аутомобиле), аутоматски превод језика (Мајкрософт преводилац, Гугл преводилац), препознавање лица (Еплов Фејс ИД или Мајкрософтов Дипфејс и Гуглов Фејснет) и означавање слика (које користе Фејсбук, Еплов Ајфото и Тикток).

Здравље и медицина

[уреди | уреди извор]Примена вештачке интелигенције у медицини и медицинским истраживањима има потенцијал да побољша негу пацијената и квалитет живота.[132] Кроз сочиво Хипократске заклетве, медицински радници су етички приморани да користе вештачку интелигенцију, ако апликације могу прецизније да дијагнозирају и лече пацијенте.

За медицинска истраживања, ВИ је важан алат за обраду и интеграцију великих количина података. Ово је посебно важно за развој органоидног и ткивног инжењеринга који користи микроскопско снимање као кључну технику у производњи.[133] Предложено је да вештачка интелигенција може да превазиђе разлике у финансирању додељене различитим областима истраживања.[133] Нови ВИ алати могу продубити наше разумевање биомедицински релевантних путева. На пример, Алфафолд 2 (2021) је показао способност да се апроксимира, у временском распону од неколико сати, а не месеци, 3Д структура протеина.[134] Године 2023, објављено је да је откривање лекова вођено вештачком интелигенцијом помогло у проналажењу класе антибиотика способних да убију две различите врсте бактерија отпорних на лекове.[135]

Игре

[уреди | уреди извор]Програми за играње игрица се користе од 1950-их за демонстрацију и тестирање најнапреднијих техника вештачке интелигенције.[136] Дип блу је постао први компјутерски систем за играње шаха који је победио актуелног светског шампиона у шаху, Гарија Каспарова, 11. маја 1997. године.[137] Године 2011, у егзибиционом мечу квиз шоа Jeopardy!, IBM-ов систем одговора на питања, Вотсон, победио је два највећа шампиона шоа, Брада Рутера и Кена Џенингса, са значајном маргином.[138] У марту 2016, Алфаго је победио у 4 од 5 игара гоа у мечу са го шампионом Лијем Седолом, поставши први компјутерски го-играчки систем који је победио професионалног го играча без хендикепа. Затим је 2017. победио Ке Јија, који је био најбољи го играч на свету.[139] Други програми обрађују игре са несавршеним информацијама, као што је програм за играње покера Плурибус.[140] Дипмајд је развио све генералистичке моделе подржаног учења, као што је Музеро, који би се могао обучити да игра шах, го или Атари игре.[141] У 2019. години, Дипмајндов Алфастар је достигао ниво велемајстора у Старкрафт II, посебно изазовној стратешкој игри у реалном времену која укључује непотпуно знање о томе шта се дешава на мапи.[142] Године 2021, ВИ агент се такмичио у Плејстејшон Гран Турисмо такмичењу, победивши четири најбоља светска возача Гран Турисма користећи подржано дубоко учење.[143]

Војска

[уреди | уреди извор]Разне земље примењују ВИ војне апликације.[144] Главне апликације побољшавају команду и контролу, комуникације, сензоре, интеграцију и интероперабилност.[145] Истраживање је усмерено на прикупљање и анализу обавештајних података, логистику, сајбер операције, информационе операције, и полуаутономна и аутономна возила.[144] ВИ технологије омогућавају координацију сензора и ефектора, откривање и идентификацију претњи, обележавање непријатељских позиција, фокусирање на мете, координацију и деконфликацију дистрибуираних заједничких паљби између умрежених борбених возила која укључују тимове са посадом и без посаде.[145] ВИ је била укључена у војне операције у Ираку и Сирији.[144]

У новембру 2023. године, потпредседница САД Камала Харис објавила је декларацију коју је потписала 31 држава о постављању заштитних ограда за војну употребу IA. Обавезе укључују коришћење правних прегледа како би се осигурала усклађеност војне вештачке интелигенције са међународним законима, као и опрез и транспарентност у развоју ове технологије.[146]

Генеративна вештачка интелигенција

[уреди | уреди извор]

Почетком 2020-их, генеративна вештачка интелигенција је стекла широку важност. У марту 2023, 58% одраслих у САД је чуло за ChatGPT, а 14% га је опробало.[147] Све већи реализам и лакоћа коришћења генератора текста у слику заснованих на вештачкој интелигенцији, као што су Midjourney, DALL-E и Стабилна дифузија, изазвали су тренд виралних ВИ-генерисаних фотографија. Широку пажњу привукла је лажна фотографија папе Фрање у белом пуфер капуту, измишљено хапшење Доналда Трампа и обмана о нападу на Пентагон, као и употреба у професионалној креативној уметности.[148][149]

Задаци специфични за индустрију

[уреди | уреди извор]Такође постоје хиљаде успешних ВИ апликација које се користе за решавање специфичних проблема за одређене индустрије или институције. У истраживању из 2017. године, једна од пет компанија је изјавила да је инкорпорирала „ВИ“ у неке понуде или процесе.[150] Неколико примера су складиштење енергије, медицинска дијагностика, војна логистика, апликације које предвиђају резултат судских одлука, спољна политика или управљање ланцем снабдевања.

У пољопривреди, вештачка интелигенција је помогла пољопривредницима да идентификују подручја којима је потребно наводњавање, ђубрење, третмани пестицидима, што доводи до повећања приноса. Агрономи користе вештачку интелигенцију за спровођење истраживања и развоја. ВИ се користи за предвиђање времена сазревања усева као што је парадајз, праћење влаге у земљишту, управљање пољопривредним роботима, спровођење предиктивне аналитике, класификацију емоција парења код свиња, аутоматизацију стакленика, откривање болести и штеточина, и уштеду воде.

Вештачка интелигенција се користи у астрономији за анализу све веће количине доступних података и апликација, углавном за „класификацију, регресију, груписање, предвиђање, генерисање, откриће и развој нових научних увида“, на пример за откривање егзопланета, предвиђање соларне активности и разликовање сигнала и инструменталних ефеката у астрономији гравитационих таласа. Такође би се могла користити за активности у свемиру као што је истраживање свемира, укључујући анализу података из свемирских мисија, научне одлуке свемирских летелица у реалном времену, избегавање свемирског отпада и аутономнији рад.

Етика

[уреди | уреди извор]Вештачка интелигенција, као и свака моћна технологија, има потенцијалне предности и потенцијалне ризике. Сматра се да вештачка интелигенција може да унапреди науку и пронађе решења за озбиљне проблеме: Демис Хасабис из Дип Мајнда се нада да ће „решити интелигенцију, а затим то искористити да реши све остало“.[151] Међутим, како је употреба вештачке интелигенције постала широко распрострањена, идентификовано је неколико нежељених последица и ризика.[152]

Свако ко жели да користи машинско учење као део стварног света, система у производњи, треба да уведе етику у своје процесе ВИ обуке и настоји да избегне пристрасност. Ово је посебно тачно када се у дубоком учењу користе ВИ алгоритми који су инхерентно необјашњиви.[153]

Ризици и штета

[уреди | уреди извор]Приватност и ауторска права

[уреди | уреди извор]Алгоритми машинског учења захтевају велике количине података. Технике које се користе за добијање ових података изазвале су забринутост у вези са приватношћу, надзором и ауторским правима.

Технолошке компаније прикупљају широк спектар података од својих корисника, укључујући онлајн активности, геолокацијске податке, видео и аудио записе.[154] На пример, да би изградио алгоритме за препознавање говора, Амазон је снимио милионе приватних разговора и дозволио привременим радницима да слушају и транскрибују неке од њих.[155] Мишљења о овом широко распрострањеном надзору се крећу од оних који га виде као неопходно зло до оних за које је то очигледно неетично и кршење права на приватност.[156]

ВИ програмери тврде да је то једини начин да се испоруче вредне апликације, и да су развили неколико техника које покушавају да очувају приватност док и се даље добијају подаци, као што су агрегација података, деидентификација и диференцијална приватност.[157] Од 2016. неки стручњаци за приватност, попут Синтије Дворк, почели су да посматрају приватност у смислу правичности. Брајан Кристијан је написао да су се стручњаци окренули „од питања 'шта знају' на питање 'шта раде с тим'”.[158]

Генеративна вештачка интелигенција се често обучава на нелиценцираним делима заштићеним ауторским правима, укључујући и домене као што су слике или компјутерски код; резултат се онда користи под образложењем „поштене употребе“. Такође власници веб локација који не желе да њихов садржај заштићен ауторским правима буде ВИ индексиран или 'оструган' могу да додају код на своју веб локацију, ако не желе да њихов сајт буде индексиран од стране претраживача, који је тренутно доступан за одређене сервисе као што је OpenAI. Стручњаци се не слажу око тога колико добро и под којим околностима ће се ово образложење одржати на судовима; релевантни фактори могу укључивати „сврху и карактер коришћења дела заштићеног ауторским правима“ и „утицај на потенцијално тржиште дела заштићеног ауторским правима“.[159] Године 2023, водећи аутори (укључујући Џона Гришама и Џонатана Франзена) тужили су ВИ компаније због коришћења њиховог рада за обуку генеративне вештачке интелигенције.[160][161]

Дезинформације

[уреди | уреди извор]Јутјуб, Фејсбук и други користе системе препорука који воде кориснике до више садржаја. Овим ВИ програмима је дат циљ да максимизирају ангажовање корисника (то јест, једини циљ је био да људи што више гледају). Вештачка интелигенција је спознала да корисници имају тенденцију да бирају дезинформације, теорије завере и екстремне партијске садржаје, и да би их задржала да гледају, ВИ је препоручила више тога. Корисници су такође имали тенденцију да гледају више садржаја на исту тему, тако да је вештачка интелигенција довела људе до филтерских мехурића где су добијали више верзија истих дезинформација.[162] То је многе кориснике уверило да су дезинформације истините и на крају поткопало поверење у институције, медије и владу.[163] ВИ програм је исправно научио да максимизира свој циљ, али резултат је био штетан за друштво. Након избора у САД 2016. године, велике технолошке компаније предузеле су кораке да ублаже проблем.

Године 2022, генеративна вештачка интелигенција је почела да ствара слике, аудио, видео и текст који се не разликују од стварних фотографија, снимака, филмова или људског писања. Постоји могућност је да лоши актери користе ову технологију за стварање огромне количине дезинформација или пропаганде.[164] Пионир вештачке интелигенције Џефри Хинтон изразио је забринутост због тога што, поред осталих ризика, вештачка интелигенција омогућава „ауторитарним лидерима да манипулишу својим бирачким телом“ у великим размерама.[165]

Алгоритамска пристрасност и правичност

[уреди | уреди извор]Апликације за машинско учење ће бити пристрасне ако уче из пристрасних података.[166] Могуће је да градитељи нису свесни да пристрасност постоји.[167] Пристрасност се може унети начином на који се бирају подаци за обуку и начином на који је модел примењује.[168][166] Ако се пристрасни алгоритам користи за доношење одлука које могу озбиљно да нашкоде људима (као што може бити случај у медицини, финансијама, запошљавању, стамбеној изградњи или одржавању реда), онда алгоритам може довести до дискриминације.[169] Праведност у машинском учењу је студија о томе како спречити штету узроковану алгоритамском пристрасношћу. То је постала озбиљна област академског проучавања унутар ВИ. Истраживачи су открили да није увек могуће дефинисати „правичност“ на начин који задовољава све заинтересоване стране.[170]

Дана 28. јуна 2015, нова функција за означавање слика у Гугл фотографијама грешком је идентификовала Џеки Алсиа и пријатеља као „гориле“ јер су они црни. Систем је обучен на скупу података који је садржао врло мало слика црних људи,[171] што је проблем који се назива „диспаритет величине узорка“.[172] Гугл је „поправио” овај проблем тако што је спречио систем да било шта означи као „горила”. Осам година касније, 2023. године, Гугл фотографије и даље нису могле да идентификују горилу, као ни слични производи из Епла, Фејсбука, Мајкрософта и Амазона.[173]

COMPAS је комерцијални програм који судови у САД нашироко користе за процену вероватноће да ће оптужени постати рецидивиста. У 2016, Џулија Енгвин из Пропаблика открила је да COMPAS показује расну пристрасност, упркос чињеници да у програму нису биле наведене расе оптужених. Иако је стопа грешке за белце и за црнце једнако калибрисана на тачно 61%, грешке за сваку расу су биле различите — систем је доследно прецењивао шансе да ће црнац поновити прекршај и потцењивао шансе да белац неће то учинити.[174] У 2017. години, неколико истраживача[ј] је показало да је математички немогуће да COMPAS прихвати све могуће мере правичности када су основне стопе понављања прекршаја биле различите за белце и црнце у подацима.[176]

Програм може доносити пристрасне одлуке чак и ако подаци експлицитно не помињу проблематичну карактеристику (као што је „раса“ или „пол“). Функција ће бити у корелацији са другим карактеристикама (као што су „адреса“, „историја куповине“ или „име“), а програм ће доносити исте одлуке на основу ових карактеристика као и о „раси“ или „полу“.[177] Мориц Харт је рекао да је „најробуснија чињеница у овој области истраживања да правичност кроз слепило не функционише.“[178]

Критика COMPAS-а је истакла дубљи проблем са злоупотребом ВИ. Модели машинског учења су дизајнирани да праве „предвиђања“ која су важећа само ако се претпоставља да ће будућност личити на прошлост. Ако су обучени на основу података који укључују резултате расистичких одлука у прошлости, модели машинског учења морају предвидети да ће се расистичке одлуке доносити у будућности. Нажалост, ако апликација тада користи ова предвиђања као препоруке, неке од ових препорука ће вероватно бити расистичке.[179] Према томе, машинско учење није добро прилагођено да помогне у доношењу одлука у областима у којима постоји нада да ће будућност бити боља од прошлости. Оно је нужно дескриптивно, а не проскриптивно.[к]

Пристрасност и неправедност могу остати неоткривени, јер су градитељи претежно белци и мушкарци: међу инжењерима вештачке интелигенције, око 4% су црнци, а 20% жене.[172]

На својој Конференцији о правичности, одговорности и транспарентности 2022. (ACM FAccT 2022) Удружење за рачунарске машине у Сеулу, Јужна Кореја, представило је и објавило налазе у којима препоручује да док се не покаже да су вештачка интелигенција и роботски системи без грешака пристрасности, они нису безбедни и коришћење самоучећих неуронских мрежа обучених на огромним, нерегулисаним изворима мањкавих интернет података треба да се ограничи.[181]

Недостатак транспарентности

[уреди | уреди извор]

Многи системи вештачке интелигенције су толико сложени да њихови дизајнери не могу да објасне како се долази до одлука.[182] То је посебно случај са дубоким неуронским мрежама, у којима постоји велика количина нелинеарних односа између улаза и излаза. Међутим постоје неке популарне технике за објашњавање.[183]

Било је много случајева где је програм машинског учења прошао ригорозне тестове, али је ипак научио нешто другачије од онога што су програмери намеравали. На пример, откривено је да систем који би могао да идентификује кожне болести боље од медицинских стручњака заправо има јаку тенденцију да класификује слике са лењиром као „канцерогене“, јер слике малигнитета обично укључују лењир који показује размеру.[184] Утврђено је да је један други систем машинског учења, који је осмишљен да помогне у ефикасној алокацији медицинских ресурса, класификује пацијенте са астмом да имају „ниски ризик” да умру од упале плућа. Имати астму је заправо озбиљан фактор ризика, али пошто би пацијенти са астмом обично добијали много више медицинске неге, релативно мало је вероватно да ће умрети према подацима обуке. Корелација између астме и ниског ризика од умирања од упале плућа била је стварна, али заваравајућа.[185]

Људи који су оштећени одлуком алгоритма имају право на објашњење. Од лекара се, на пример, захтева да јасно и потпуно објасне разлоге за сваку одлуку коју донесу.[186] Рани нацрти Опште уредбе о заштити података Европске уније из 2016. године укључивали су експлицитну изјаву да ово право постоји.[л] Стручњаци из индустрије су приметили да је ово нерешен проблем без решења на видику. Регулатори су тврдили да је штета ипак стварна: ако проблем нема решење, не треба користити алате.[187] DARPA је успоставила програм XAI („Објашњива вештачка интелигенција“) 2014. у покушају да се реше ови проблеми.[188]

Постоји неколико потенцијалних решења за проблем транспарентности. SHAP помаже да се визуелизује допринос сваке карактеристике резултату.[189] LIME може локално апроксимирати модел са једноставнијим моделом који се може интерпретирати.[190] Вишезадатно учење пружа велики број резултата поред циљне класификације. Ови други резултати могу помоћи развијачима да разлуче шта је мрежа научила.[191] Деконволуција, Дипдрим и друге генеративне методе могу омогућити стручњацима да виде шта су различити слојеви дубоке мреже научили и произведу излаз који може да сугерише шта мрежа учи.[192]

Конфликт, присмотра и наоружана вештачка интелигенција

[уреди | уреди извор]Смртоносно аутономно оружје је машина која лоцира, бира и ангажује људске мете без људског надзора.[љ] До 2015. године пријављено је да преко педесет земаља истражује роботе на бојном пољу.[194] Ово оружје се сматра посебно опасним из неколико разлога: ако убије невину особу, није јасно ко треба да одговара, мало је вероватно да ће поуздано изабрати мете, а ако се производи у великим размерама, то је потенцијално оружје за масовно уништење.[195] У 2014. години, 30 држава (укључујући Кину) подржало је забрану аутономног оружја у складу са Конвенцијом о одређеном конвенционалном оружју Уједињених нација, међутим Сједињене Државе и други се с тим нису сложили.[196]

Вештачка интелигенција пружа низ алата који су посебно корисни за ауторитарне владе: паметни шпијунски софтвер, препознавање лица и гласа омогућавају широко распрострањено праћење; такав надзор омогућава машинском учењу да класификује потенцијалне непријатеље државе и може спречити да се скривају; системи препорука могу прецизно испоручивати пропаганду и дезинформације ради максималног ефекта; дипфејкови и генеративна вештачка интелигенција помажу у стварању дезинформација; напредна вештачка интелигенција може учинити ауторитарно централизовано доношење одлука конкурентнијим либералним и децентрализованим системима као што су тржишта.[197]

Системи вештачке интелигенције за препознавање лица се користе за масовно надгледање, посебно у Кини.[198][199] Године 2019, Бенгалуру у Индији је поставио саобраћајне сигнале којима управља вештачка интелигенција. Овај систем користи камере за праћење густине саобраћаја и прилагођавање времена сигнала на основу интервала потребног за растерећење саобраћаја.[200] Терористи, криминалци и одметничке државе могу да користе наоружану вештачку интелигенцију као што је напредно дигитално ратовање и смртоносно аутономно оружје. Вештачка интелигенција са машинским учењем је такође у стању да дизајнира десетине хиљада токсичних молекула за неколико сати.[201]

Безбедносне смернице за протеине дизајниране вештачком интелигенцијом

[уреди | уреди извор]Истраживачи су покренули иницијативу која позива на безбедну и етичку употребу дизајна протеина. Добровољни напор долази након извештаја законодаваца, истраживачких центара и других организација које истражују могућност да алати вештачке интелигенције — у распону од мрежа за предвиђање структуре протеина као што је Алфафолд до великих језичких модела као што је онај који покреће ChatGPT — могу олакшати за развој биолошког оружја, укључујући нове токсине или високо преносиве вирусе. Нова иницијатива позива биодизајнерску заједницу да врши контролу и да се побољша скрининг синтезе ДНК, што је кључни корак у прављењу протеина дизајнираних посредством вештачке интелигенције, за потенцијално штетне молекуле.[202][203]

Технолошка незапосленост

[уреди | уреди извор]Од раних дана развоја вештачке интелигенције постојали су аргументи, на пример они које је изнео Џозеф Вајзенбаум, о томе да ли задатке које рачунари могу да обављају заправо они треба да раде, с обзиром на разлику између рачунара и људи, и између квантитативног израчунавања и квалитативног вредносног просуђивања.[204]

Економисти су често истицали ризике од отпуштања услед деловања вештачке интелигенције и спекулисали о незапослености уколико не постоји адекватна социјална политика за пуну запосленост.[205]

У прошлости, технологија је имала тенденцију да повећава, а не да смањује укупну запосленост, али економисти признају да смо „на неистраженој територији“ са вештачком интелигенцијом.[206][205] Економска истраживања су показала неслагање око тога да ли ће све већа употреба робота и вештачке интелигенције изазвати значајно повећање дугорочне незапослености, али се генерално слажу да би то могло бити нето корисно ако се прерасподели повећање продуктивности.[207] Процене ризика варирају; на пример, током 2010-их, Мајкл Озборн и Карл Бенедикт Фреј су проценили да је 47% радних места у САД изложено „високом ризику” од потенцијалне аутоматизације, док је један OECD извештај класификовао само 9% послова у САД као „високи ризик”.[м][209] Методологија спекулисања о будућим нивоима запослености је критикована по основи недостатка доказног темеља и због имплицирања да технологија, а не социјална политика, ствара незапосленост, за разлику од отпуштања.[205]

У контасту са претходним таласима аутоматизације, многи послови средње класе могу бити елиминисани вештачком интелигенцијом; The Economist је 2015. године навео да је „забринутост да би вештачка интелигенција могла да уради пословима белих оковратника оно што је парна енергија учинила онима са плавим оковратницима током индустријске револуције“ „вредно озбиљно разматрања“.[210] Екстремно ризични послови се крећу од правних помоћника до кувара брзе хране, док ће потражња вероватно порасти за професијама везаним за негу, од личне здравствене заштите до свештенства.[211]

У априлу 2023. објављено је да је 70% послова за кинеске илустраторе видео игрица елиминисано генеративном вештачком интелигенцијом.[212][213]

Егзистенцијални ризик

[уреди | уреди извор]Тврдило се да ће вештачка интелигенција постати толико моћна да би човечанство могло неповратно изгубити контролу над њом. Ово би, како је изјавио физичар Стивен Хокинг, могло да „доведе до краја људске расе“.[214] Овај сценарио је уобичајен у научној фантастици, када компјутер или робот изненада развију „самосвест“ (или „свесност“) налик човеку и постану злонамерни.[н] Ови сценарији научне фантастике су обмањујући на неколико начина.

Прво, вештачка интелигенција не захтева „свесност” налик људској да би била егзистенцијални ризик. Савременим програмима вештачке интелигенције дају се специфични циљеви и они користе учење и интелигенцију да би их постигли. Филозоф Ник Бостром је тврдио да ако неко зада скоро било који циљ довољно моћној вештачкој интелигенцији, она може изабрати да уништи човечанство да би то постигла (користио је пример менаџера фабрике спајалица).[216] Стјуарт Расел даје пример кућног робота који покушава да пронађе начин да убије свог власника како би спречио да буде искључен, резонујући да „не можеш донети кафу ако си мртав.“[217] Да би било безбедна за човечанство, суперинтелигенција би морала да буде истински усклађена са моралом и вредностима човечанства како би била „у основи на нашој страни“.[218]

Друго, Јувал Ноа Харари тврди да вештачкој интелигенцији није потребно тело робота или физичка контрола да би представљала егзистенцијални ризик. Есенцијални делови цивилизације нису физички. Ствари као што су идеологије, закон, [влада], новац и економија су говорне конструкције; постоје јер постоје приче у које верују милијарде људи. Тренутна преваленција дезинформација сугерише да би вештачка интелигенција могла да користи језик да убеди људе да верују у било шта, чак и да предузму акције које су деструктивне.[219]

Мишљења међу стручњацима и инсајдерима из индустрије нису јединствена, при чему постоје знатне фракције које су забринуте и као и оне које нису забринуте због ризика од евентуалне суперинтелигентне вештачке интелигенције.[220] Личности као што су Стивен Хокинг, Бил Гејтс и Елон Маск изразиле су забринутост због егзистенцијалног ризика од вештачке интелигенције.[221]

Почетком 2010-их, стручњаци су тврдили да су ризици у сувише удаљеној будућности да би оправдали истраживање или да ће људи бити вредни из перспективе суперинтелигентне машине.[222] Међутим, након 2016. године, проучавање садашњих и будућих ризика и могућих решења постало је озбиљна област истраживања.[223]

Пионири вештачке интелигенције, као што су Феј-Феј Ли, Џофри Хинтон, Јошуа Бенџо, Синтија Брезил, Рана ел Калиоуби, Демис Хасабис, Џој Буоламвини и Сам Олтман, изразили су забринутост због ризика од вештачке интелигенције. Године 2023, многи водећи стручњаци за вештачку интелигенцију издали су заједничку изјаву да би „ублажавање ризика од изумирања од вештачке интелигенције требало да буде глобални приоритет заједно са другим ризицима на друштвеном нивоу као што су пандемије и нуклеарни рат“.[224]

Други истраживачи су, међутим, говорили у прилог мање дистопијског гледишта. Пионир вештачке интелигенције Јирген Шмидубер није потписао заједничку изјаву, наглашавајући да се у 95% свих случајева истраживање вештачке интелигенције односи на настојање да „људски животи буду дужи, здравији и лакши“.[225] Док алати који се сада користе за побољшање живота исто тако могу да се користе у лоше сврхе, „они такође могу да се користе као негативни чиниоци.“[226][227] Ендру Нг је такође тврдио да је „грешка је наседати на гласине о вештачкој интелигенцији — и да ће регулатори који то чине имати само користи од стечених интереса."[228] Јан Лекан „исмијава дистопијске сценарије својих пандана препуне дезинформација, па чак и евентуално изумирање човечанства”.[229]

Ограничавање вештачке интелигенције

[уреди | уреди извор]Могуће опције за ограничавање вештачке интелигенције укључују: коришћење уграђене етике или уставне вештачке интелигенције где компаније или владе могу да уносе прописе, ограничавање високог нивоа рачунарске моћи у обуци, ограничавање могућности прераде сопствене кодне базе, ограничавање одређених техника вештачке интелигенције, али не у фази обуке, отворен код (транспарентност) у односу на власнички код (могао би бити у већој мери ограничен), резервни модел са редундантношћу, ограничавање безбедности, приватности и ауторских права, ограничавање или контрола меморије, праћење у реалном времену, анализа ризика, искључивање у хитним случајевима, ригорозна симулација и тестирање, сертификација модела, процена познатих рањивости, ограничавање материјала за обуку, ограничавање приступа интернету, издавање услова коришћења.

Етичке машине и усклађивање

[уреди | уреди извор]Пријатељска вештачка интелигенција су машине које су дизајниране од почетка да минимизирају ризике и да доносе одлуке од користи људима. Елизер Јадковски, који је сковао термин, тврди да развој пријатељске вештачке интелигенције треба да буде виши приоритет истраживања: то може захтевати велика улагања и мора бити окончано пре него што вештачка интелигенција постане егзистенцијални ризик.[230]

Машине са интелигенцијом имају потенцијал да искористе своју интелигенцију за доношење етичких одлука. Област машинске етике обезбеђује машинама етичке принципе и процедуре за решавање етичких дилема.[231] Област машинске етике се такође назива рачунарска моралност,[231] и основана је на AAAI симпозијуму 2005. године.[232]

Други приступи укључују „вештачке моралне агенте” Вендела Валаха[233] и три принципа Стјуарта Џ. Расела за развој доказано корисних машина.[234]

Оквири

[уреди | уреди извор]Пројекти вештачке интелигенције могу да се тестирају по основи њихове етичке прихватљивости током дизајнирања, развоја и имплементације система вештачке интелигенције. Оквир вештачке интелигенције као што је Пазите и поступајте оквир који садржи SUM вредности – који је развио Алан Тјурингов институт тестира пројекте у четири главне области:[235][236]

- Поштовање достојанство појединачних људи

- Повезивање са другим људима искрено, отворено и инклузивно

- Брига за добробит свих

- Заштита друштвених вредности, правде и јавног интереса

Остали напреци у етичким оквирима укључују оне о којима је одлучено током Асиломар конференције, Монтреалску декларацију за одговорну вештачку интелигенцију и иницијативу IEEE за етику аутономних система, између осталог;[237] међутим, ови принципи не пролазе без критике, посебно у погледу људски одабраних доприноса овим оквирима.[238]

Промовисање благостања људи и заједница на које ове технологије утичу захтева разматрање друштвених и етичких импликација у свим фазама дизајна, развоја и имплементације система вештачке интелигенције, као и сарадњу између радних улога као што су научници података, менаџери производа, инжењери података, доменски стручњаци и менаџери испоруке.[239]

Регулација

[уреди | уреди извор]

Регулисање вештачке интелигенције је развој политика јавног сектора и закона за промовисање и регулисање вештачке интелигенције; стога је везано за ширу регулацију алгоритама.[240] Регулаторни и политички пејзаж за вештачку интелигенцију је ново питање у јурисдикцијама широм света.[241] Према станфордском Индексу вештачке интелигенције, годишњи број закона у вези са вештачком интелигенцијом усвојених у 127 разматраних земаља скочио је са једног усвојеног у 2016. на 37 усвојених само у 2022. години.[242][243] Између 2016. и 2020. године, више од 30 земаља усвојило је наменске стратегије за вештачку интелигенцију.[244] Већина држава чланица ЕУ објавила је националне стратегије вештачке интелигенције, као и Канада, Кина, Индија, Јапан, Маурицијус, Руска Федерација, Саудијска Арабија, Уједињени Арапски Емирати, САД и Вијетнам. Други су били у процесу израде сопствене стратегије вештачке интелигенције, укључујући Бангладеш, Малезију и Тунис.[244] Глобално партнерство за вештачку интелигенцију покренуто је у јуну 2020. године, наводећи потребу да се вештачка интелигенција развија у складу са људским правима и демократским вредностима, како би се обезбедило поверење јавности и поуздање у технологију.[244] Хенри Кисинџер, Ерик Шмит и Данијел Хатенлохер објавили су заједничку изјаву у новембру 2021. позивајући на владину комисију која би регулисала вештачку интелигенцију.[245] У 2023. години, лидери OpenAI објавили су препоруке за управљање суперинтелигенцијом, за коју верују да би се могло формирати за мање од 10 година.[246] Уједињене нације су 2023. године такође покренуле саветодавно тело за давање препорука о управљању вештачком интелигенцијом; тело се састоји од руководилаца технолошких компанија, владиних званичника и академика.[247]

У истраживању Ипсоса из 2022. године, ставови према вештачкој интелигенцији су се веома разликовали од земље до земље; 78% кинеских грађана, али само 35% Американаца, сложило се да „производи и услуге који користе вештачку интелигенцију имају више предности него недостатака“.[242] Анкета Ројтерс/Ипсоса из 2023. показала је да се 61% Американаца слаже, а 22% се не слаже, да вештачка интелигенција представља ризик за човечанство.[248] У анкети Фок Њуза из 2023. године, 35% Американаца мислило је да је то „веома важно”, а додатних 41% мислило је да је „донекле важно” да савезна влада регулише вештачку интелигенцију, наспрам 13% који је одговорило „не баш важно” и 8% је одговорило „уопште није важно”.[249][250]

У новембру 2023, одржан је први глобални Самит о безбедности вештачке интелигенције у Блечли парку у Великој Британији да би се разговарало о краткорочним и даљим ризицима вештачке интелигенције и могућности обавезних и добровољних регулаторних оквира.[251] Сет од 28 земаља, укључујући Сједињене Државе, Кину и Европску унију, издао је декларацију на почетку самита, позивајући на међународну сарадњу у управљању изазовима и ризицима вештачке интелигенције.[252][253]

Историја

[уреди | уреди извор]Историјски преглед развоја

[уреди | уреди извор]Појам вештачка интелигенција (ВИ), настаје лета 1956. године у Дартмуду, Хановер (САД), на скупу истраживача заинтересованих за теме интелигенције, неуронских мрежа и теорије аутомата. Скуп је организовао Џон Макарти, уједно са Клодом Шеноном, Марвином Минским и Н. Рочестером. На скупу су такође учествовали Т. Мур (Принстон), А. Семјуел (IBM), Р. Соломоноф и О. Селфриџ (МИТ), као и А. Невил, Х. Сајмон (Carnegie Tech, данас Карнеги Мелон универзитет). На скупу су постављене основе области вештачке интелигенције и трасиран пут за њен даљи развој.

Раније, 1950. године, Алан Тјуринг је објавио један чланак у ревији Мајнд ((Mind)), под насловом „Рачунари и интелигенција“, где говори о концепту вештачке интелигенције и поставља основе једне врсте пробе, преко које би се утврђивало да ли се одређени рачунарски систем понаша у складу са оним што се подразумева под вештачком интелигенцијом, или не. Касније ће та врста пробе добити име, Тјурингов тест.

Скуп је последица првих радова у области. Невил и Сајмон су на њему представили свој програм за аутоматско резоновање, Логик Теорист (који је направио сензацију). Данас се сматра да су концепт вештачке интелигенције поставили В. Мекулок и M. Питс, 1943. године, у раду у ком се представља модел вештачких неурона на бази три извора: спознаја о физиологији и функционисању можданих неурона, исказна логика Расела и Вајтехеда, и Тјурингова компутациона теорија. Неколико година касније створен је први неурални рачунар SNARC. Заслужни за подухват су студенти Принстона, Марвин Мински и Д. Едмонс, 1951. године. Негде из исте епохе су и први програми за шах, чији су аутори Шенон и Тјуринг.

Иако се ова истраживања сматрају зачетком вештачке интелигенције, постоје многа друга који су битно утицала на развој ове области. Нека потичу из области као што су филозофија (први покушаји формализације резоновања су силогизми грчког филозофа Аристотела), математика (теорија одлучивања и теорија пробабилитета се примењују у многим данашњим системима), или психологија (која је заједно са вештачком интелигенцијом формирала област когнитивне науке).

У годинама које следе скуп у Дартмуду постижу се значајни напреци. Конструишу се програми који решавају различите проблеме. На пример, студенти Марвина Минског су крајем шездесетих година имплементирати програм Analogy, који је оспособљен за решавање геометријских проблема, сличним онима који се јављају у тестовима интелигенције, и програм Студент, који решава алгебарске проблеме написане на енглеском језику. Невил и Сајмон ће развити General Problem Solver (ГПС), који покушава да имитира људско резоновање. Семјуел је написао програме за игру сличну дами, који су били оспособљени за учење те игре. Макарти, који је у међувремену отишао на МИТ, имплементира програмски језик Лисп, 1958. године. Исте године је написао чланак, Programs With Common Sense, где описује један хипотетички програм који се сматра првим комплетним системом вештачке интелигенције.

Ова серија успеха се ломи средином шездесетих година и превише оптимистичка предвиђања из ранијих година се фрустрирају. До тада имплементирани системи су функционисали у ограниченим доменима, познатим као микросветови (microworlds). Трансформација која би омогућила њихову примену у стварним окружењима није била тако лако изводљива, упркос очекивањима многих истраживача. По Раселу и Норивигу, постоје три фундаментална фактора који су то онемогућили:

- Многи дизајнирани системи нису поседовали сазнање о окружењу примене, или је имплементирано сазнање било врло ниског нивоа и састојало се од неких једноставних синтактичких манипулација.

- Многи проблеми које су покушавали решити су били у суштини нерешиви, боље речено, док је количина сазнања била мала и ограничена решење је било могуће, али када би дошло до пораста обима сазнања, проблеми постају нерешиви.

- Неке од основних структура које су се користиле за стварање одређеног интелигентног понашања су биле веома ограничене.

До тог момента решавање проблема је било засновано на једном механизму опште претраге преко којег се покушавају повезати, корак по корак, елементарне основе размишљања да би се дошло до коначног решења. Наравно такав приступ подразумева и велике издатке, те да би се смањили, развијају се први алгоритми за потребе контролисања трошкова истраживања. На пример, Едсхер Дајкстра 1959. године дизајнира један метод за стабилизацију издатака, Невил и Ернст, 1965. године развијају концепт хеуристичке претраге и Харт, Нилсон и Рафаел, алгоритам А. У исто време, у вези програма за игре, дефинише се претрага алфа-бета. Творац идеје је иначе био Макарти, 1956. године, а касније ју је користио Невил, 1958. године.

Важност схватања сазнања у контексту домена и примене, као и грађе структуре, којој би било лако приступати, довела је до детаљнијих студија метода представљања сазнања. Између осталих, дефинисале су се семантичке мреже (дефинисане почетком шездесетих година, од стране Килијана) и окружења (које је дефинисао Мински 1975. године). У истом периоду почињу да се користе одређене врсте логике за представљање сазнања.

Паралелно с тим, током истих година, настављају се истраживања за стварање система за игру чекерс, за који је заслужан Самуел, оријентисан на имплементацију неке врсте методе учења. Е. Б. Хунт, Ј. Мартин и П. Т. Стоне, 1969. године конструишу хијерархијску структуру одлука (ради класификације), коју је већ идејно поставио Шенон, 1949. године. Килијан, 1979, представља метод IDZ који треба да послужи као основа за конструкцију такве структуре. С друге стране, П. Винстон, 1979. године, развија властити програм за учење описа сложених објеката, и Т. Мичел, 1977, развија тзв. простор верзија. Касније, средином осамдесетих, поновна примена методе учења на неуралне мреже тзв., backpropagation, доводи до поновног оживљавања ове области. Конструкција апликација за стварна окружења, довела је до потребе разматрања аспеката као што су неизвесност, или непрецизност (који се такође јављају приликом решавања проблема у играма). За решавање ових проблема примењиване су пробабилистичке методе (теорија пробабилитета, или пробабилистичке мреже) и развијали други формализми као дифузни скупови (дефинисани од Л. Задеха 1965. године), или Демпстер-Шаферова теорија (творац теорије је А. Демпстер, 1968, са значајним доприносом Г. Шафера 1976. године). На основу ових истраживања, почев од осамдесетих година, конструишу се први комерцијални системи вештачке интелигенције, углавном тзв. експертски системи.

Савремени проблеми који се настоје решити у истраживањима вештачке интелигенције, везани су за настојања конструисања кооперативних система на бази агената, укључујући системе за управљање подацима, утврђивање редоследа обраде података и покушаје имитације природног језика, између осталих.

Историја вештачке интелигенције

[уреди | уреди извор]Проучавање механичког или „формалног” расуђивања почело је са филозофима и математичарима у антици. Проучавање логике довело је директно до теорије рачунања Алана Тјуринга, која је сугерисала да машина, мешањем симбола једноставних као што су „0“ и „1“, може да симулира математичку дедукцију и формално резоновање, које је познато као Черч-Тјурингова теза.[254] Ово, заједно са истовременим открићима у кибернетици и теорији информација, навело је истраживаче да размотре могућност изградње „електронског мозга“.[њ][256]

Алан Тјуринг је размишљао о машинској интелигенцији бар од 1941. године, када је дистрибуирао рад о машинској интелигенцији који би могао бити најранији рад у области вештачке интелигенције – иако је сада изгубљен.[8] Први доступни рад који је генерално препознат као „вештачка интелигенција“ био је Макалуков и Питсов дизајн за Тјуринг-комплетне „вештачке неуроне“ из 1943. године – први математички модел неуронске мреже.[257] На рад је утицао Тјурингов ранији рад „О израчунљивим бројевима“ из 1936. који је користио сличне логичке „неуроне“ са два стања, али је био први који их је применио на неуронске функције.[8]

Алан Туринг је током свог живота користио термин „машинска интелигенција“ која је касније често називана „вештачком интелигенцијом“ након његове смрти 1954. године. Тјуринг је 1950. године објавио најпознатији од својих радова „Рачунарска машинерија и интелигенција“, у које је представио свој концепт онога што је сада познато као Тјурингов тест широј јавности. Затим су уследила три Тјурингова радио-емисија о вештачкој интелигенцији, предавања: „Интелигентна машинерија, јеретичка теорија“, „Могу ли дигитални рачунари да мисле“? и панел дискусија „Може ли се за аутоматске рачунске машине рећи да мисле“. До 1956. године компјутерска интелигенција се у Британији активно изучавала више од једне деценије; тамо су написани најранији програми вештачке интелигенције током 1951–1952.[8]

Године 1951, коришћењем компјутера Феранти Марк 1 Универзитета у Манчестеру, написани су програми за игре дама и шах где је особа могла да игра против компјутера.[258] Област америчког истраживања вештачке интелигенције основана је на радионици на Дартмут колеџу 1956. године.[о][9] Полазници су постали лидери истраживања вештачке интелигенције током 1960-их.[п] Они и њихови студенти производили су програме које је штампа описала као „зачуђујуће”:[р] компјутери су учили стратегије игре дама, решавали проблеме са речима у алгебри, доказивали логичке теореме и говорили енглески.[с][10] Лабораторије за вештачку интелигенцију су основане на бројним британским и америчким универзитетима током касних 1950-их и раних 1960-их.[8]

Они су, међутим, потценили тежину проблема.[т] Америчка и британска влада прекинуле су експлоративна истраживања као одговор на критику сер Џејмса Лајхила[263] и стални притисак америчког Конгреса да финансира продуктивније пројекте. Минскијева и Папертова књига Перцептрони је схваћена као доказ да вештачке неуронске мреже никада неће бити корисне за решавање задатака у стварном свету, чиме се потпуно дискредитује приступ.[264] Уследила је „зима вештачке интелигенције“, период када је добијање средстава за пројекте вештачке интелигенције било тешко.[12]

Почетком 1980-их, истраживање вештачке интелигенције је оживело комерцијалним успехом експертских система,[265] облика програма вештачке интелигенције који је симулирао знање и аналитичке вештине људских стручњака. До 1985. године тржиште вештачке интелигенције достигло је преко милијарду долара. Истовремено, јапански компјутерски пројекат пете генерације инспирисао је владе САД и Велике Британије да поврате финансирање академских истраживања.[11] Међутим, почевши од колапса тржишта Лисп машина 1987. године, вештачка интелигенција је поново пала на лош глас и почела је друга, дуготрајнија зима.[13]